Bevor Du das nächste Meeting-Transkript in Gemini hochlädst oder Deinen Report in NotebookLM analysierst, musst Du eines verstehen: Die Spielregeln haben sich 2026 grundlegend geändert. Der EU AI Act ist voll durchsetzbar – und Ignoranz schützt hier vor Strafe nicht.

Wir reden nicht über Kleinigkeiten, sondern über Bußgelder von bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes. Dieser Guide zeigt Dir, wie Du Gemini und NotebookLM nutzt, ohne rechtlich in die „rote Zone“ zu geraten.

Inhaltsverzeichnis

Die Rote Zone: Was im Büro strikt verboten ist

Die EU bewertet bestimmte Praktiken als „unannehmbares Risiko“. Wenn Du hier landest, hilft keine Checkliste mehr – Du brichst das Gesetz.

-

Emotionserkennung am Arbeitsplatz: Du lädst ein Zoom-Interview in Gemini hoch und fragst: „Wirkte der Bewerber unehrlich?“ Stopp. KI darf im Job-Kontext nicht genutzt werden, um den „inneren Zustand“ oder Emotionen zu bewerten.

-

Social Scoring im Office: NotebookLM mit Mitarbeiter-Mails füttern, um einen „Loyalitäts-Index“ oder ein Ranking der „zuverlässigsten Kollegen“ zu erstellen? Verboten. Das Kategorisieren von Menschen zur Bewertung ihres sozialen Verhaltens ist ein No-Go.

High-Risk & Transparenz: Die HR-Falle

90 % der Corporate Use Cases fallen in die Orange Zone. Hier gelten strenge Transparenz- und Dokumentationspflichten.

-

Employment & HR: Wer KI nutzt, um Bewerbungen zu filtern oder Beförderungen vorzuschlagen, betreibt ein High-Risk-System. Da Gemini ein General-Purpose-Modell ist, fehlt oft die nötige HR-Zertifizierung für diesen spezifischen Zweck.

-

Kennzeichnungspflicht (Art. 50): Wenn ein KI-Agent automatisch auf Kundenbeschwerden antwortet, muss der Kunde wissen, dass er mit einer Maschine spricht. Transparenz ist hier Dein rechtliches Schutzschild.

💡 Expert-Insight: Pilot vs. Passagier

Der EU AI Act will KI nicht verhindern, sondern rücksichtslosen Einsatz stoppen. Werde zum Pilot: Kontrolliere, was das System „frisst“ (Input), und verifiziere kritisch, was es ausspuckt (Output). Die Verantwortung bleibt zu 100 % bei Dir, nicht beim Tool.

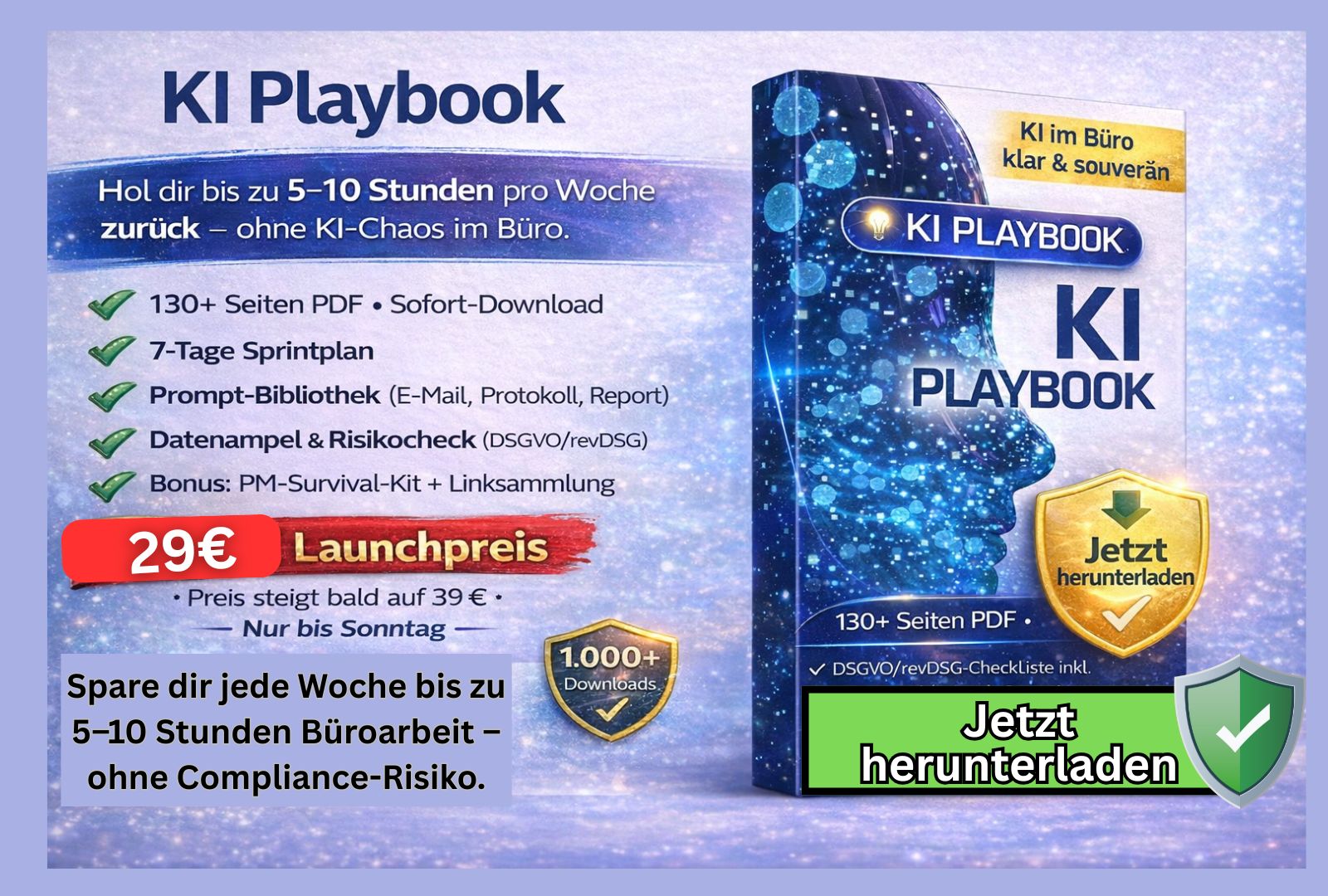

Das KI Playbook: Sicher skalieren statt riskieren

Compliance muss nicht kompliziert sein. Im KI Playbook findest Du fertige Blueprints und datenschutzkonforme Vorlagen, die genau auf die Anforderungen des EU AI Acts abgestimmt sind. So nutzt Du die volle Power der KI, während Du rechtlich auf der sicheren Seite bleibst.

👉

Datenschlacht: Gemini vs. NotebookLM

Um compliant zu bleiben, musst Du den architektonischen Unterschied verstehen:

-

Google Gemini: In der Standard-Version können Daten potenziell zum Training genutzt werden. Das ist bei personenbezogenen Kundendaten ein massiver Verstoß gegen die Data Governance des AI Acts.

-

NotebookLM: Nutzt zwar RAG (Retrieval Augmented Generation), um Antworten in Deinen Quellen zu „grounden“, aber: Wenn Deine Quellen einen Bias haben (z. B. historisch schlechtere Bewertungen für bestimmte Gruppen), reproduziert die KI diesen Fehler. Du haftest für das diskriminierungsfreie Ergebnis.

Der sichere Workflow: 4 Schritte zur Compliance

So bleibst Du in der „grünen Zone“ und arbeitest trotzdem brutal effizient:

-

Anonymisierungs-Filter: Keine Namen, keine Adressen. Ersetze „Max Mustermann“ durch „Kunde A“, bevor Du Daten hochlädst.

-

Vier-Augen-Prinzip (Human-in-the-Loop): KI-Output wird niemals direkt übernommen. Du prüfst und editierst. Das macht aus einer „automatisierten Entscheidung“ eine „KI-gestützte Assistenz“.

-

Transparenz-Tag: Nutze Footer wie: „Erstellt mit Unterstützung von KI, verifiziert durch [Dein Name].“

-

Zweckbindung: Nutze Gemini für Brainstorming und NotebookLM für Fakten-Checks interner (anonymisierter!) Dokumente. Mische niemals sensible HR-Daten in öffentliche Chat-Fenster.

FAQ

Was ist der EU AI Act einfach erklärt? Der EU AI Act ist das weltweit erste umfassende Gesetz zur Regulierung von Künstlicher Intelligenz. Er unterteilt KI-Anwendungen in Risikoklassen (Unannehmbar, Hoch, Gering) und legt fest, welche Transparenz- und Sicherheitsstandards Unternehmen einhalten müssen.

Darf ich Gemini noch für meine Arbeit nutzen? Ja, solange Du die Vorgaben zur Emotionserkennung und zum Datenschutz (DSGVO) beachtest. Für High-Risk-Bereiche wie Personalwesen gelten jedoch zusätzliche Dokumentationspflichten.

Wie hoch sind die Strafen beim Verstoß gegen den EU AI Act? Die Bußgelder sind drastisch: Je nach Schwere des Verstoßes drohen bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes eines Unternehmens.

Ist NotebookLM sicherer als Gemini? NotebookLM minimiert Halluzinationen durch Quellbezug, ersetzt aber keine Datenschutz-Prüfung. Beide Tools sollten im professionellen Kontext nur mit anonymisierten Daten oder in abgesicherten Enterprise-Umgebungen genutzt werden.

Fazit: Der einzige Weg, wie KI im Büro wirklich Profit bringt, ist Geschwindigkeit ohne Selbstverbrennung. Werde zum Experten für sichere Workflows.